Em uma tentativa de promover seu assistente de IA, a Microsoft acabou expondo uma falha fundamental do Copilot no Windows 11. Durante uma campanha publicitária em parceria com um criador de conteúdo, o assistente artificial forneceu instruções incorretas sobre como redimensionar texto no sistema operacional, levantando questões sobre a eficácia real da tecnologia.

O anúncio que revelou a falha

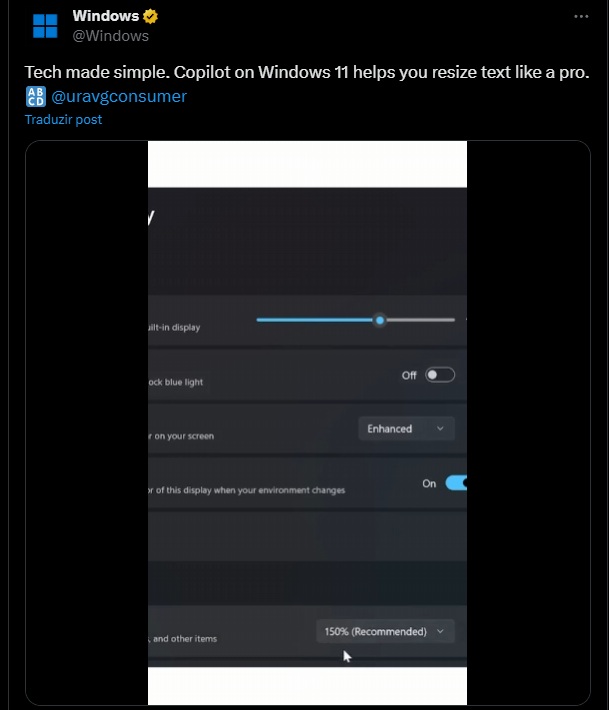

A Microsoft colaborou com o criador de conteúdo Judner Aura (@UrAvgConsumer) para demonstrar as capacidades do Copilot.

O que deveria ser uma demonstração das capacidades da IA se transformou em um momento embaraçoso. O Copilot prontamente explicou passo a passo como acessar as configurações de tela e alterar a escala do display para 150%. O problema? O sistema já estava configurado em 150%.

Na minha experiência com assistentes de IA, esse tipo de erro básico de contexto é particularmente frustrante. Aura, tentando salvar a situação, simplesmente aumentou a escala para 200% e seguiu em frente. Mas fica a pergunta: como uma "inteligência" artificial integrada ao sistema operacional não consegue reconhecer a configuração atual do próprio ambiente em que está rodando?

Críticas da comunidade e problemas mais profundos

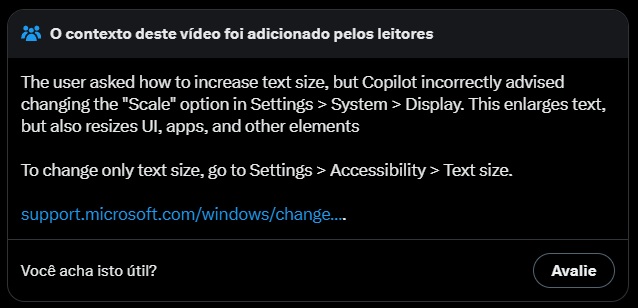

O erro do Copilot foi apenas o começo dos problemas. O anúncio na conta oficial do Windows recebeu uma nota da comunidade questionando a qualidade da resposta fornecida pela IA. E aqui está algo que me surpreendeu: o usuário pediu especificamente para redimensionar texto, mas o Copilot instruiu a alterar a escala de toda a tela, o que afeta interface, aplicativos e diversos outros elementos além do texto.

O Windows 11 possui configurações específicas para redimensionar apenas o texto nas opções de acessibilidade, e era para lá que o Copilot deveria ter direcionado o usuário. Essa falta de precisão na interpretação de comandos é algo que observo frequentemente em assistentes de IA - eles parecem entender as palavras, mas não necessariamente a intenção por trás delas.

E as críticas não param por aí. A maioria das respostas ao anúncio demonstra pouca impressão com o recurso, com usuários destacando que um assistente verdadeiramente eficiente seria capaz de alterar a configuração automaticamente, em vez de fornecer instruções que qualquer pessoa poderia encontrar no Google.

O contexto mais amplo da aposta da Microsoft em IA

Este incidente ocorre em um momento crucial para a Microsoft, que tem apostado pesadamente em IA e está tentando convencer os usuários a adotarem o uso constante do Copilot no Windows 11.

A empresa até mesmo planeja um Windows guiado pelo Copilot e baseado em conversas, mas episódios como esse levantam dúvidas sobre se a tecnologia está realmente pronta para assumir um papel tão central no sistema operacional.

Outras iniciativas da Microsoft com IA também geram questionamentos, como o Gaming Copilot que captura a tela durante gameplay, embora a empresa afirme não usar essas capturas para treinar a IA.

Enquanto isso, a Microsoft continua trabalhando em melhorias para o Windows 11, incluindo a resolução de bugs nos menus de contexto, mas o desafio de tornar a IA verdadeiramente útil e confiável parece ser muito maior do que problemas técnicos convencionais.

O desafio da integração contextual

O que realmente me impressiona nesse caso específico é que o Copilot não apenas falhou em fornecer a resposta correta, mas demonstrou uma incapacidade fundamental de compreender o contexto do sistema onde está integrado. Pense comigo: se um assistente humano estivesse ajudando alguém com um problema de computador, a primeira coisa que faria seria verificar as configurações atuais antes de sugerir mudanças. Por que a IA não faz isso?

Na verdade, essa limitação vai além do exemplo do redimensionamento de texto. Em meus próprios testes com o Copilot, notei que ele frequentemente oferece soluções genéricas que ignoram o estado atual do sistema. É como ter um assistente que lê manuais, mas não olha para a máquina que está tentando consertar.

As expectativas versus a realidade dos assistentes de IA

O que me deixa um tanto frustrado é a desconexão entre o que as empresas prometem e o que realmente entregam. A Microsoft descreve o Copilot como um "assistente pessoal para o Windows 11", mas na prática, ele se comporta mais como um chatbot com acesso limitado ao sistema. E isso levanta uma questão importante: os usuários estão sendo levados a acreditar que a IA é mais inteligente e integrada do que realmente é?

Vários usuários no Reddit e Twitter compartilham experiências semelhantes. Um deles mencionou que pediu ao Copilot para abrir um aplicativo específico que já estava em execução em segundo plano, e a IA simplesmente forneceu instruções genéricas sobre como iniciar programas, sem perceber que o aplicativo já estava ativo. São esses pequenos fracassos contextuais que acumulam e minam a confiança do usuário.

E aqui está algo interessante que observei: quando você faz uma pergunta mais complexa ao Copilot, ele frequentemente recua para respostas do tipo "faça uma pesquisa na web" em vez de tentar resolver o problema usando as ferramentas do sistema. Isso me faz questionar - a integração é realmente profunda o suficiente para justificar o marketing agressivo?

O caminho adiante para assistentes de IA confiáveis

Enquanto a Microsoft lida com essas críticas, outras empresas também enfrentam desafios semelhantes. O Google Assistant e a Siri da Apple têm seus próprios problemas de compreensão contextual, embora em diferentes graus. O que diferencia o caso da Microsoft é que eles estão tentando posicionar o Copilot como central para a experiência do Windows, não apenas como um recurso opcional.

Alguns especialistas em UX que acompanho argumentam que o problema fundamental está na arquitetura desses sistemas de IA. Eles são treinados em dados massivos da web, mas não necessariamente entendem a semântica específica de um sistema operacional ou o contexto imediato do usuário. É como contratar um bibliotecário para consertar seu carro - ele pode ter acesso a todos os manuais, mas não sabe como aplicar esse conhecimento na prática.

E tem mais uma camada nessa discussão: a privacidade. Para que um assistente de IA seja verdadeiramente útil e contextual, ele precisaria ter acesso a muito mais dados do sistema e do usuário. Mas isso cria um dilema - quanto acesso estamos dispostos a conceder em troca de conveniência? A Microsoft já enfrentou críticas sobre coleta de dados no Windows 11, e uma IA mais integrada certamente ampliaria essas preocupações.

O que me surpreende é que, apesar desses desafios óbvios, a Microsoft continua testando novos recursos para o Copilot e expandindo suas capacidades. Recentemente, a empresa começou a integrar mais funções do sistema, permitindo que o Copilot execute algumas ações diretamente, em vez de apenas fornecer instruções. É um passo na direção certa, mas ainda parece insuficiente diante das expectativas criadas.

Enquanto isso, desenvolvedores independentes criam ferramentas alternativas que, embora menos ambiciosas, resolvem problemas específicos de forma mais confiável. Essa dicotomia entre o macro (a grande promessa da IA) e o micro (soluções práticas que realmente funcionam) define o momento atual dos assistentes digitais. E honestamente, não sei qual caminho vencerá no longo prazo.

Com informações do: Adrenaline