A NVIDIA, já uma força dominante no cenário de hardware para inteligência artificial com suas GPUs, acaba de dar um passo ousado em um novo território. A empresa anunciou a CPU NVIDIA Vera, que ela proclama como o primeiro processador do mundo desenvolvido especificamente para a era dos agentes de IA e do aprendizado por reforço. E os números são impressionantes: a promessa é de resultados com o dobro da eficiência e 50% mais rápidos do que CPUs tradicionais de grande escala. Mas será que isso é apenas marketing, ou a Vera realmente representa uma mudança de paradigma? Vamos mergulhar nos detalhes.

O Que Torna a Vera Diferente?

A Vera não é apenas uma CPU mais rápida; é uma nova classe de processador. Enquanto a maioria das CPUs de servidor é projetada para ser um "faz-tudo" – lidando com banco de dados, servidores web, virtualização – a Vera nasceu com um propósito singular: ser o cérebro central para "fábricas de IA". Seu objetivo declarado é "desbloquear os agentes de IA em escala".

O que isso significa na prática? Pense nos assistentes de IA que escrevem código, analisam documentos complexos ou gerenciam fluxos de trabalho automatizados. Esses agentes exigem uma responsividade extrema e a capacidade de executar milhares, talvez milhões, de instâncias simultâneas. CPUs tradicionais podem engasgar nesse tipo de carga. A Vera, segundo a NVIDIA, foi arquitetada desde o silício para isso.

Ela se apoia na base estabelecida pela CPU NVIDIA Grace, mas leva a especialização a um novo nível. O cerne da Vera são seus 88 núcleos personalizados "Olympus", projetados internamente pela NVIDIA. Cada núcleo pode executar duas tarefas simultaneamente graças à tecnologia NVIDIA Spatial Multithreading, algo que visa oferecer desempenho consistente mesmo sob carga pesada e multi-inquilino. É como ter um maestro excepcionalmente eficiente para uma orquestra de processos de IA.

Parcerias e a Arquitetura por Trás do Poder

Uma nova arquitetura só é relevante se for adotada. E aqui, a NVIDIA parece ter feito sua lição de casa. A lista de parceiros que já estão colaborando para implementar a Vera é um "quem é quem" da computação em nuvem e de servidores: Alibaba, CoreWeave, Meta, Oracle Cloud Infrastructure, Dell Technologies, HPE, Lenovo e Supermicro. Essa ampla adoção inicial sugere que a NVIDIA não está apenas lançando um chip, mas tentando estabelecer um novo padrão industrial.

Mas o hardware é só uma parte da equação. A NVIDIA anunciou um rack completo de CPUs Vera que é, por si só, uma pequena revolução. Este rack integra 256 CPUs Vera com refrigeração líquida e é capaz de suportar mais de 22.500 ambientes de CPU independentes operando simultaneamente. A ideia é que uma "fábrica de IA" completa possa ser implantada e dimensionada rapidamente dentro de um único rack físico. Isso é escalabilidade agressiva.

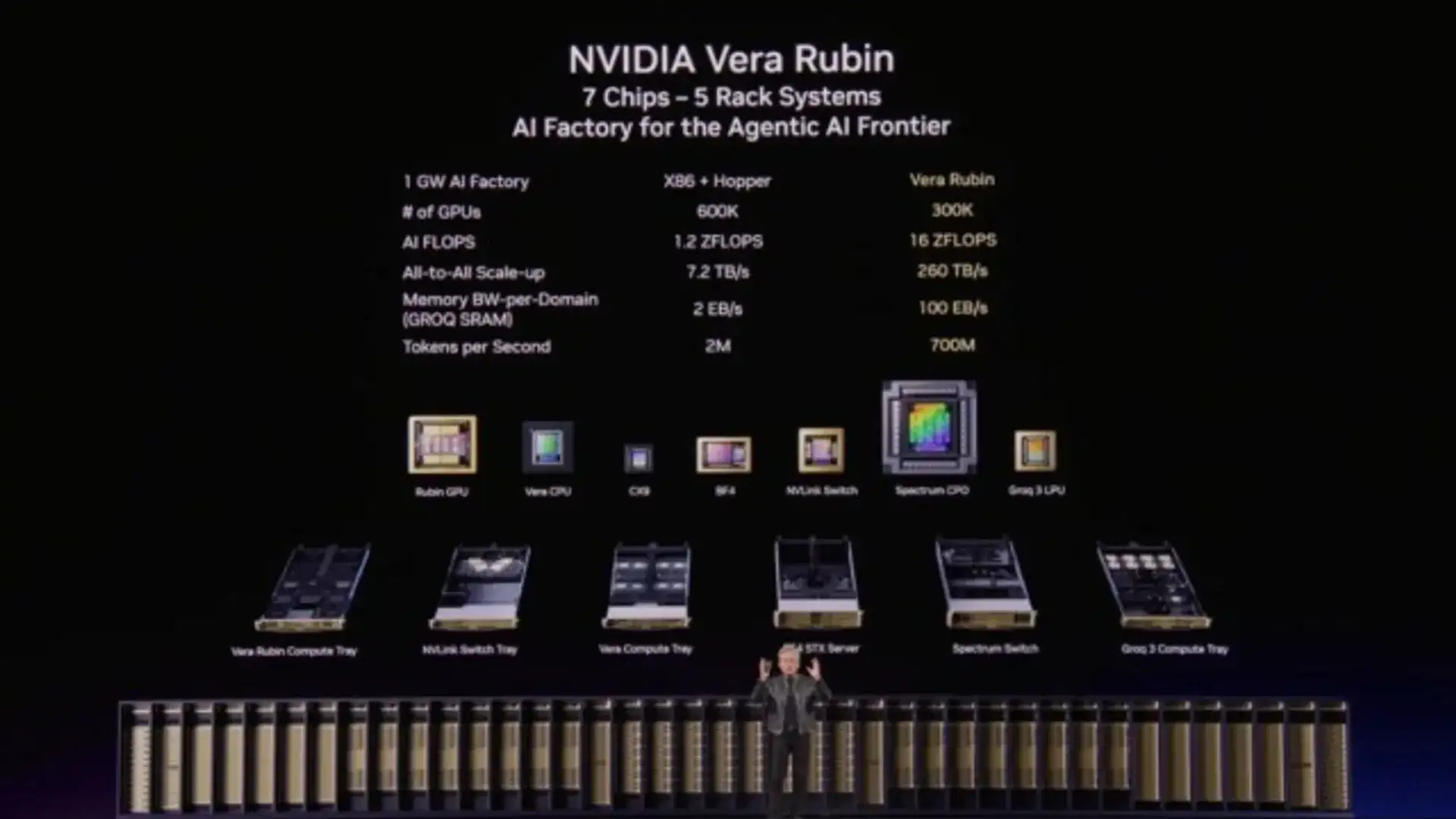

A integração com o resto do ecossistema NVIDIA é, claro, total. Como parte da plataforma NVIDIA Vera Rubin NVL72, as CPUs Vera são emparelhadas com GPUs NVIDIA através da interconexão NVLink™-C2C, oferecendo uma largura de banda absurda de 1,8 TB/s – sete vezes mais rápida que o PCIe Gen 6. Essa conexão ultrarrápida entre CPU e GPU é crítica para evitar gargalos em cargas de trabalho de IA complexas.

E não para por aí. Os sistemas Vera também integram as placas de rede ConnectX SuperNIC e as DPUs (Unidades de Processamento de Dados) BlueField-4 da NVIDIA. Em minha opinião, esse é o verdadeiro golpe de mestre: a NVIDIA não está vendendo uma CPU, está vendendo uma plataforma completa e otimizada, da rede ao armazenamento, passando pela segurança e pelo processamento. É um ecossistema fechado, mas tremendamente poderoso.

Foco em Eficiência e no Futuro dos Agentes

Um dos argumentos mais fortes da NVIDIA para a Vera é a eficiência energética. E isso vai além do marketing verde; em data centers que consomem megawatts, eficiência se traduz diretamente em custos operacionais massivos. A Vera apresenta a segunda geração do subsistema de memória de baixo consumo da NVIDIA, agora usando memória LPDDR5X.

O resultado? Até 1,2 TB/s de largura de banda de memória com – pasmem – a metade do consumo de energia em comparação com CPUs de uso geral, segundo a empresa. Para cargas de trabalho de aprendizado por reforço, onde os agentes de IA estão constantemente simulando, aprendendo e tomando decisões, essa eficiência pode ser a diferença entre um projeto viável e um economicamente proibitivo.

O aprendizado por reforço, em particular, é um campo que está explodindo. É a técnica por trás de alguns dos agentes de IA mais avançados, que aprendem por tentativa e erro em ambientes simulados. Essas simulações são brutais para o hardware, exigindo respostas rápidas sob condições de uso extremas. A Vera foi projetada para ser a plataforma estável e responsiva no coração desse furacão computacional.

E então, o que isso significa para o mercado? A AMD e a Intel certamente estão observando. A NVIDIA está efetivamente usando seu domínio no mercado de IA para criar uma nova demanda por um tipo especializado de CPU e, em seguida, atendendo essa demanda com seu próprio produto. É uma estratégia vertical poderosa. Se a Vera for tão bem-sucedida quanto as GPUs da empresa, podemos estar testemunhando o início de uma nova era de domínio arquitetônico da NVIDIA, não apenas na aceleração, mas no coração da computação dos data centers modernos.

Fontes: NVIDIA, Adrenaline.

O Impacto Prático: O Que a Vera Significa para Desenvolvedores e Empresas

Para quem está fora do mundo dos data centers de hiperescala, é fácil pensar que a Vera é apenas mais um chip para gigantes da tecnologia. Mas a verdade é que seu impacto pode se infiltrar de maneiras mais sutis e amplas. Imagine, por exemplo, uma startup que desenvolve um agente de IA para otimizar cadeias de logística. Hoje, eles podem depender de instâncias de nuvem genéricas, onde o custo para treinar e executar seu modelo é alto e a latência é imprevisível.

Com plataformas como a Vera disponíveis através de provedores de nuvem como a Oracle ou a CoreWeave, essa mesma startup pode, teoricamente, acessar um hardware otimizado sob demanda. O resultado? Ciclos de desenvolvimento mais rápidos, custos de inferência mais baixos e a capacidade de oferecer respostas em tempo real – algo que pode ser a diferença entre vencer ou perder para um concorrente. A democratização do hardware de ponta via nuvem é um subproduto poderoso dessas inovações.

E para os desenvolvedores, a mudança pode ser ainda mais fundamental. A arquitetura da Vera e seu software associado podem exigir uma nova mentalidade de programação. Em vez de escrever código para uma CPU de propósito geral, os engenheiros poderão otimizar seus agentes de IA para explorar ao máximo o multithreading espacial e a interconexão ultrarrápida com as GPUs. É um salto semelhante, em espírito, à programação para GPUs há uma década – inicialmente um nicho, mas hoje uma habilidade essencial.

Os Desafios e as Perguntas que Permanecem

Claro, nenhuma revolução tecnológica vem sem seus poréns. E a estratégia da NVIDIA com a Vera levanta algumas questões interessantes, para não dizer espinhosas. A primeira é o já mencionado ecossistema fechado. Ao oferecer uma plataforma completa – CPU, GPU, rede, software – a NVIDIA cria uma experiência incrivelmente eficiente, mas também potencialmente cria uma dependência. Para uma empresa, migrar de um ecossistema NVIDIA completo para uma solução mista de AMD, Intel e Mellanox no futuro poderia se tornar um pesadelo de complexidade.

Isso é bom ou ruim? Depende do seu ponto de vista. De um lado, você tem otimização extrema e simplicidade de integração. Do outro, menos flexibilidade e possivelmente menos pressão competitiva sobre os preços a longo prazo. Em minha experiência, as empresas tendem a abraçar a eficiência imediata, especialmente em um campo que se move tão rápido quanto a IA. O risco de ficar para trás parece maior do que o risco do vendor lock-in.

Outra grande interrogação paira sobre o software. Hardware poderoso é inútil sem um sistema operacional e pilhas de software que possam explorá-lo. A NVIDIA anunciou que a Vera será suportada por todas as principais distribuições Linux e frameworks de IA, mas a verdadeira otimização virá das camadas de software proprietárias da empresa, como o NVIDIA AI Enterprise. Até que ponto essas otimizações serão abertas ou permanecerão como um segredo guardado a sete chaves? A comunidade de código aberto conseguirá acompanhar o ritmo?

E não podemos ignorar a reação dos concorrentes. A AMD, com suas CPUs EPYC, e a Intel, com Xeon, não vão simplesmente ceder este novo mercado. Ambas têm suas próprias tecnologias de aceleração de IA (como os núcleos AI da Intel ou a arquitetura XDNA da AMD) e vastas bases de clientes instaladas. A batalha não será apenas por desempenho bruto, mas por facilidade de adoção, custo total de propriedade e, crucialmente, pela mente dos desenvolvedores. Será que veremos uma resposta na forma de CPUs igualmente especializadas desses gigantes, ou eles dobrarão a aposta na versatilidade de seus designs atuais?

Além dos Data Centers: Um Vislumbre do Futuro

É tentador pensar na Vera como um produto estritamente para o back-end, escondido em prédios sem janelas. Mas a história nos ensina que as inovações em data centers têm um hábito de, eventualmente, filtrar para o consumidor. A computação em nuvem, afinal, é o que permite os apps em nossos smartphones. A especialização radical que a Vera representa pode ser um sinal do que está por vir em outros segmentos.

Pense nos PCs gamers de alto desempenho. Eles já são, essencialmente, máquinas especializadas. E se, no futuro, uma parte significativa da carga de trabalho de um usuário avançado for gerada por agentes de IA locais – assistentes pessoais hipercapacitados, ferramentas de criação de conteúdo generativo, simuladores complexos? Não é difícil imaginar uma CPU para desktop com uma arquitetura inspirada na Vera, otimizada para coordenar tarefas de IA entre uma GPU poderosa e outros aceleradores.

Mais imediatamente, o sucesso da Vera pode acelerar a chegada de aplicações que hoje consideramos no limite da ficção científica. Ambientes de simulação massivamente paralelos e realistas para treinar robôs ou veículos autônomos; modelos de linguagem que podem manter contextos absurdamente longos e realizar raciocínios complexos em tempo real; sistemas de descoberta científica que iteram através de milhões de hipóteses simuladas. Essas coisas não são mais apenas sonhos. Elas são problemas de engenharia de hardware e software. E a Vera é a resposta da NVIDIA para o problema de hardware.

O lançamento da CPU Vera não é um produto isolado. É a declaração mais clara até agora de que a NVIDIA vê o futuro da computação não como uma evolução gradual, mas como uma redefinição fundamental em torno da inteligência artificial. A empresa está apostando que a CPU de propósito geral, tal como a conhecemos, não é a ferramenta ideal para a próxima década de inovação em software. E, considerando seu histórico, é uma aposta que ninguém no setor pode dar ao luxo de ignorar. O que me deixa curioso é: como as próprias ferramentas de desenvolvimento de software vão evoluir para tirar proveito total dessa nova matéria-prima computacional? Os compiladores, os depuradores, os sistemas em tempo de execução – tudo isso precisará ser repensado.

Com informações do: Adrenaline