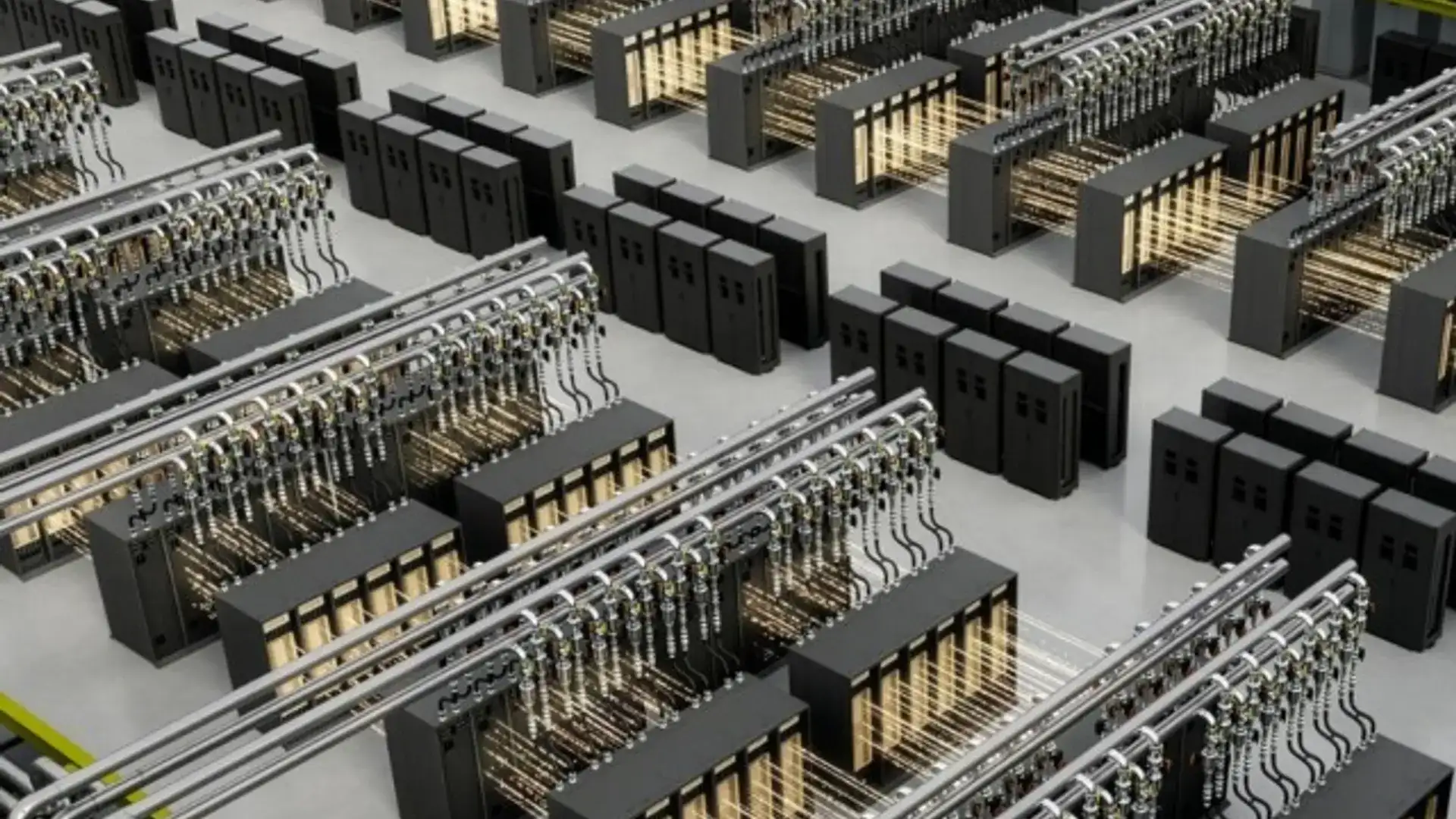

A corrida pela supremacia em inteligência artificial está entrando em uma nova fase, uma que se desenrola não apenas em laboratórios de software, mas em vastos complexos industriais. A NVIDIA, já uma força dominante no fornecimento de chips para IA, agora mira um alvo ainda maior: a própria infraestrutura física que abrigará e alimentará a próxima geração de modelos. O anúncio do projeto de referência Vera Rubin DSX AI Factory é, na verdade, um manual de instruções para construir as usinas de processamento de dados do amanhã. E, francamente, a escala do que está sendo proposto é algo que redefine o conceito de "data center".

O desafio colossal das fábricas de IA

Pense no último modelo de linguagem que você viu sendo anunciado. Agora, imagine a energia e o resfriamento necessários para treiná-lo, e depois para executar suas inferências milhões de vezes por segundo, globalmente. Não é só sobre empilhar mais GPUs. É um quebra-cabeça monumental de engenharia. Coordenar o fluxo de energia elétrica suficiente para uma pequena cidade, dissipar o calor colossal gerado, garantir que a rede de comunicação entre os chips não engargale, e fazer tudo isso de forma eficiente e escalável. É esse problema sistêmico que o projeto Vera Rubin DSX pretende resolver.

O projeto funciona como um guia de melhores práticas, um "kit de iniciação" para quem quer construir uma dessas fábricas. Ele abrange desde o design do cluster de computação com as GPUs NVIDIA e a rede Ethernet Spectrum-X™ até os sistemas mais mundanos, porém vitais, de energia e refrigeração. A ideia é criar uma receita para um desempenho repetível. Em vez de cada empresa reinventar a roda (e arriscar um colapso térmico ou elétrico no processo), elas podem seguir um projeto validado. Isso acelera a construção e, teoricamente, reduz os riscos. Empresas pesadas como Siemens, Schneider Electric e Dassault Systèmes já estão envolvidas, o que sugere que o plano é levar isso do papel para o concreto.

Software: o cérebro que orquestra o gigante

Aqui está uma parte que muitas vezes é subestimada: o hardware é apenas o músculo. O que torna uma fábrica de IA verdadeiramente inteligente é o software que a gerencia. E a NVIDIA está lançando uma suíte completa de ferramentas para essa finalidade. A plataforma Vera Rubin DSX é descrita como aberta e modular, o que é crucial para atrair um ecossistema diversificado.

Vamos aos componentes-chave. O DSX Max-Q (um nome que remete à sua tecnologia de laptops eficientes) foca em extrair o máximo de tokens de IA por watt de energia. Em um ambiente onde a conta de luz pode ser o maior custo operacional, otimizar isso não é um luxo, é uma necessidade de sobrevivência. Já o DSX Flex é fascinante: ele permite que a fábrica "converse" com a rede elétrica, ajustando dinamicamente seu consumo. Imagine poder reduzir momentaneamente a potência quando a rede está sobrecarregada, ou usar energia de fontes locais (como solar) de forma inteligente. Isso transforma a fábrica de um simples consumidor voraz em um participante ativo do grid energético.

Por fim, o DSX Exchange atua como um tradutor universal, integrando os sinais dos mundos de TI (tecnologia da informação) e OT (tecnologia operacional). É isso que permite que o sistema de resfriamento reaja automaticamente a um pico de carga em um rack de servidores, por exemplo.

Simular antes de construir: a era do "digital twin"

Talvez a ferramenta mais poderosa no arsenal seja o NVIDIA Omniverse DSX Blueprint, agora disponível publicamente. Esta é a aplicação prática do conceito de "gêmeo digital" em sua forma mais ambiciosa. Antes de gastar um único dólar em concreto e cabos de cobre, os engenheiros podem construir uma réplica virtual fiel de toda a fábrica dentro do Omniverse.

Eles podem simular como o ar quente se move entre os corredores, testar diferentes layouts de racks, modelar falhas na alimentação de energia e ver o impacto no desempenho computacional. Podem até simular a logística de manutenção. Isso não é apenas um exercício de visualização bonito; é uma ferramenta que pode economizar centenas de milhões em erros de projeto e acelerar drasticamente o tempo para a fábrica entrar em operação e gerar receita. A promessa é clara: otimizar no mundo virtual para maximizar a eficiência no mundo real.

O que a NVIDIA está fazendo vai muito além de vender chips. Ela está tentando estabelecer o padrão arquitetônico, o sistema operacional e até o método de planejamento para a próxima geração de infraestrutura de computação. É uma jogada para se entrincheirar ainda mais no ecossistema de IA, tornando-se não só o fornecedor dos processadores, mas também o consultor de como construir a casa que os abriga. A pergunta que fica é: com tantos gigantes da indústria participando, esse se tornará o modelo *de facto* para qualquer um que queira construir uma fábrica de IA em escala? E que implicações isso tem para a diversidade e resiliência dessa infraestrutura crítica que sustentará cada vez mais aspectos da nossa economia e sociedade?

Fonte: NVIDIA.

Mas vamos pensar um pouco mais sobre essa "receita" que a NVIDIA está oferecendo. Por um lado, a padronização é incrivelmente sedutora. Para um CEO ou CFO olhando para um projeto de bilhões de dólares, a promessa de um caminho validado, com eficiência previsível e cronograma acelerado, é quase irresistível. Reduz a incerteza, que é o verdadeiro inimigo dos grandes investimentos de capital. No entanto, essa abordagem de "kit" também levanta questões interessantes sobre inovação e lock-in. Será que ao seguir um projeto de referência tão abrangente, as empresas estarão, mesmo que sutilmente, padronizando suas infraestruturas de uma forma que as torna permanentemente dependentes do ecossistema NVIDIA? É uma eficiência que vem com um custo de flexibilidade futura?

Além do hardware: o custo oculto da energia e da água

Falamos muito sobre watts e resfriamento, mas o impacto ambiental dessas fábricas é um capítulo à parte, e uma das maiores pressões que elas enfrentarão. O DSX Flex, que permite a comunicação com a rede elétrica, é um reconhecimento tácito disso. Mas a verdade é que o apetite por energia da IA está crescendo em um ritmo que assusta até os mais otimistas. Alguns estudos sugerem que o treinamento de modelos de última geração já consome mais eletricidade do que o uso anual de centenas de casas. Agora multiplique isso por dezenas de fábricas globais, operando 24/7.

O desafio não é apenas pagar a conta, mas também a origem dessa energia. A pressão por ESG (Environmental, Social, and Governance) vai forçar essas instalações a buscarem fontes renováveis, o que nem sempre é fácil de garantir em escala e com a estabilidade necessária. E tem a água. Muitos data centers de alta densidade usam sistemas de resfriamento evaporativo, consumindo milhões de litros de água potável. Em regiões já sob estresse hídrico, isso se torna um problema social e logístico enorme. A eficiência promovida pelo Vera Rubin DSX terá que ser medida não apenas em tokens por watt, mas também em impacto ambiental por token. Essa pode ser a próxima fronteira de otimização – e de regulação.

A geopolítica das fábricas de IA

Outra camada fascinante, e um pouco assustadora, é onde essas fábricas serão construídas. Não se trata apenas de encontrar um terreno barato com boa conexão de fibra óptica. A localização se tornou uma questão estratégica de soberania nacional. Países e blocos econômicos, como os EUA, a União Europeia e a China, estão cientes de que quem controla a capacidade de computação de ponta controla, em grande parte, o ritmo da inovação em IA.

Isso está levando a uma corrida por subsídios, como o CHIPS Act americano, e a políticas que incentivam a construção local. O projeto Vera Rubin DSX, portanto, não é apenas um documento técnico; é uma ferramenta que pode acelerar a realização dessas ambições geopolíticas. Um país que queira rapidamente estabelecer sua própria capacidade soberana de IA pode, em tese, adotar o projeto como base. Mas, novamente, isso cria uma dependência de uma empresa americana (a NVIDIA) para uma infraestrutura crítica. Você consegue ver o paradoxo? A busca por autonomia estratégica pode, ironicamente, levar a uma padronização global arquitetada por um único player. Como isso se desdobrará nos próximos anos será crucial para o mapa de poder tecnológico mundial.

E não podemos esquecer da cadeia de suprimentos. Construir uma fábrica dessas não é como montar um móvel da IKEA. Requer componentes especializados, cabos de energia de alta capacidade, unidades de resfriamento industrial, transformadores – uma lista gigantesca. A pandemia já mostrou como cadeias globais são frágeis. Uma interrupção no fornecimento de um componente aparentemente menor pode paralisar uma instalação de bilhões. Parte do valor do "gêmeo digital" do Omniverse é justamente planejar e simular essa logística complexa, mas a realidade física dos portos, navios e fábricas de componentes ainda impõe seus próprios limites.

O que vem depois da fábrica? A próxima camada do problema

Ok, digamos que a fábrica esteja construída, otimizada e operando perfeitamente. O problema acaba aí? Longe disso. Na minha visão, isso apenas resolve a camada física. A próxima grande dor de cabeça, que já começa a aparecer no horizonte, é a camada de *orquestração de carga de trabalho* em escala planetária.

Imagine um grande modelo de IA sendo usado por milhões de pessoas simultaneamente, em diferentes fusos horários. A demanda por poder de computação (inferência) flutua dramaticamente. Como você distribui essa carga de forma inteligente entre várias fábricas de IA ao redor do mundo? Como você prioriza um trabalho de treinamento crítico em São Paulo enquanto há um pico de usuários finais na Europa? E como fazer isso respeitando leis locais de dados (como o GDPR), que podem exigir que as informações de cidadãos europeus sejam processadas dentro do continente?

Isso exigirá uma camada de software de malha global ainda mais complexa do que o DSX Exchange. Algo que não apenas gerencia a energia dentro de uma fábrica, mas que gerencia o fluxo de *trabalhos de IA* entre continentes, em tempo real, balanceando custo, latência, eficiência energética e conformidade legal. É o próximo salto de abstração. Alguns chamam isso de "*intercloud for AI*" ou "*AI workload fabric*". A empresa que conseguir oferecer uma solução robusta para esse problema herdará uma posição de enorme influência, porque estará controlando o tráfego na espinha dorsal da economia da IA.

E então temos a questão da manutenção e da vida útil. Um data center tradicional pode operar por uma década ou mais com upgrades incrementais. A taxa de inovação em hardware de IA, porém, é frenética. Novas arquiteturas de chip surgem a cada poucos anos. Como você projeta uma fábrica física, com sua infraestrutura fixa de energia e resfriamento, para ser atualizável? O projeto Vera Rubin DSX terá que incorporar não apenas eficiência para o hardware de hoje, mas uma *modularidade radical* que permita trocar o "cérebro" (os racks de servidores) sem precisar reconstruir o "corpo" (o prédio inteiro). Isso é um desafio de engenharia civil e de TI fundidos em um só.

No fim das contas, o anúncio da NVIDIA é um marco porque torna visível e tangível a infraestrutura colossal que sustenta a revolução da IA que vivemos no software. Revela que o futuro da inteligência artificial é, em boa parte, um problema de engenharia pesada, logística global e gestão de recursos planetários. A pergunta que fica pairando no ar é: temos, como sociedade, a capacidade de planejar e construir essa infraestrutura de forma sustentável e resiliente, ou estamos correndo para erguer torres de Babel digitais sem fully entender seus alicerces?

Com informações do: Adrenaline